:::info این مقاله در arxiv تحت مجوز CC 4.0 موجود است.

نویسندگان:

(1) امیر نوری زادگان، گروه مهندسی عمران، دانشگاه ملی تایوان؛

(2) DL Young، Core Tech System Co. Ltd، Moldex3D، گروه مهندسی عمران، دانشگاه ملی تایوان & [email protected];

(3) YC Hon، گروه ریاضیات، دانشگاه شهر هنگ کنگ.

(4) CS Chen، گروه مهندسی عمران، دانشگاه ملی تایوان و [email protected].

:::

جدول پیوندها

چکیده و مقدمه

شبکه های عصبی

پین برای حل معادله برگر معکوس

شبکه باقیمانده

نتایج عددی

نتایج، تقدیرنامه ها و مراجع

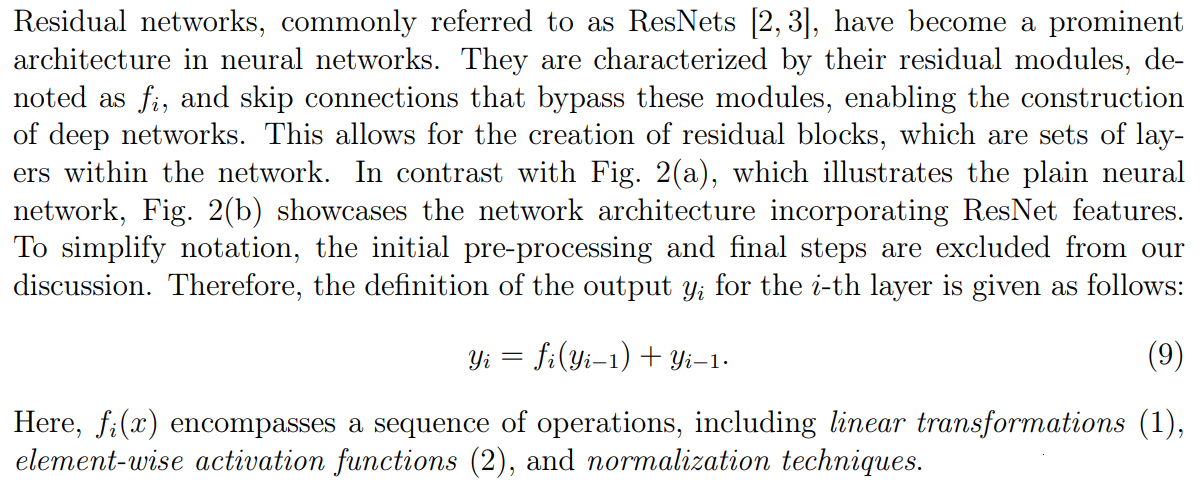

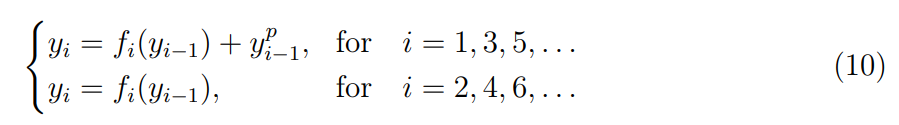

4 شبکه باقیمانده

\ در این مطالعه، یک نوع تقویتشده از ResNet را پیشنهاد میکنیم که از هر لایه دیگر که به عنوان «SkipResNet تقویتشده با قدرت» نامیده میشود، رد میشود. این اصلاح شامل تغییر تعریف بازگشتی در (9) به شرح زیر است:

\

\

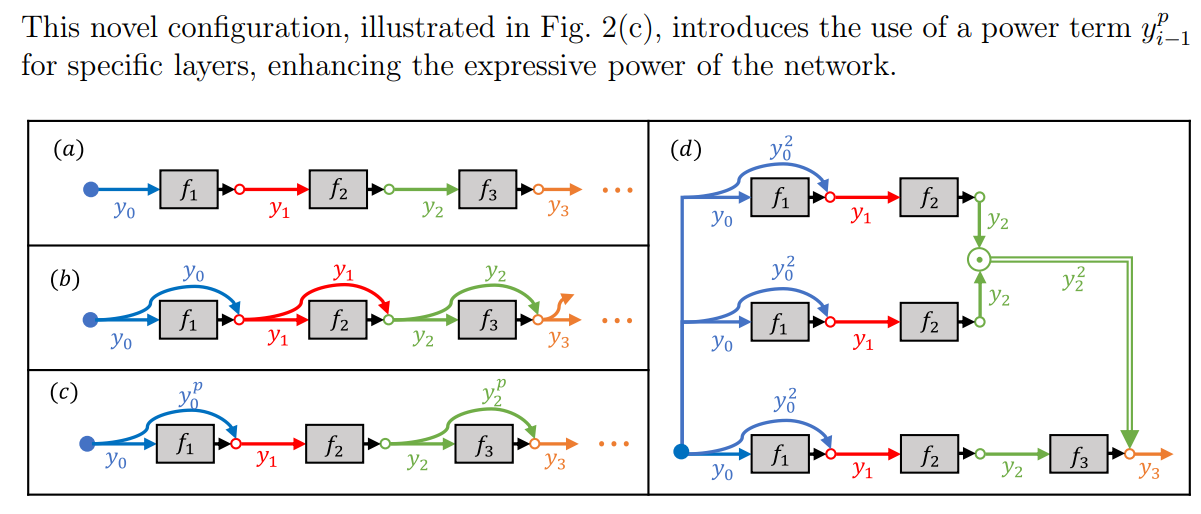

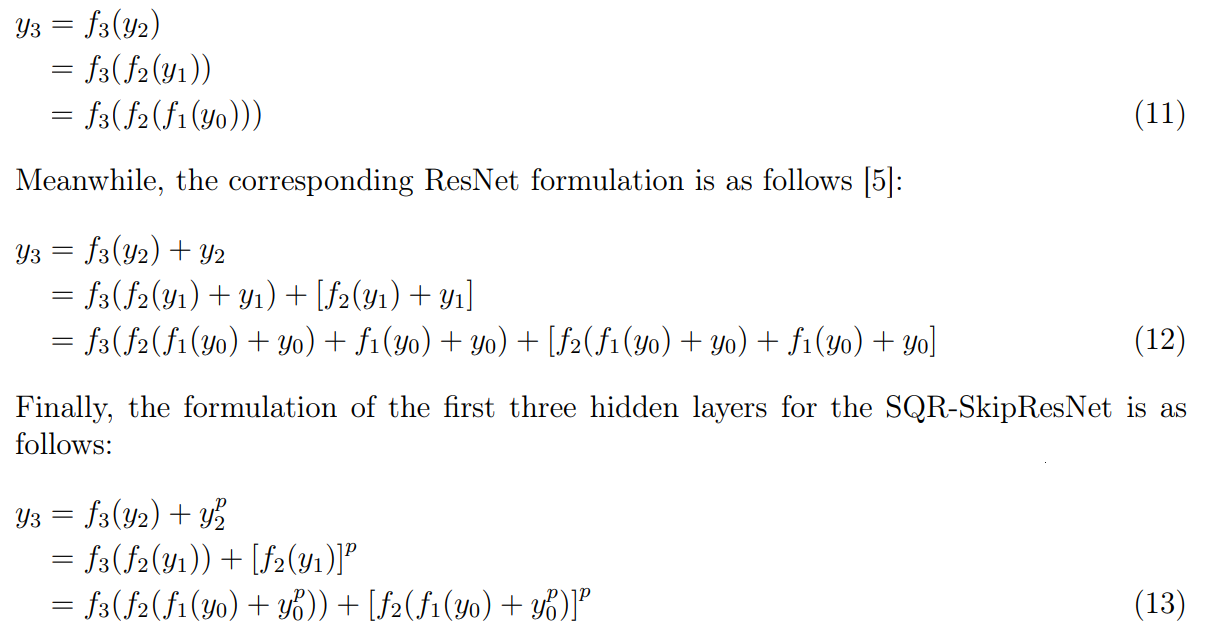

\ به منظور مقایسه بین Plain NN، ResNet و SQR-SkipResNet (شکل 2(a)-(c)، به ترتیب)، خروجی سومین لایه پنهان مربوط به ورودی y0 = X را ارزیابی می کنیم. نتایج برای شبکه عصبی ساده به شرح زیر است:

\

\ شکل 2(d) به صورت بصری “درخت بیان” را برای مورد با p = 2 نشان می دهد، که یک تصویر روشنگر از جریان داده از ورودی به خروجی ارائه می دهد. …

سئو PBN | خبر های جدید سئو و هک و سرور