OpenAI پاسخی به شکایت نیویورک تایمز را با این ادعا منتشر کرد که NYTimes از تکنیکهای تحریک دستکاری برای وادار کردن ChatGPT به بازگرداندن گزیدههای طولانی استفاده کرده است، و اظهار داشت که این دعوی مبتنی بر سوء استفاده از ChatGPT است تا نمونههایی را برای «گیلاس چیدن» برای مردم این کشور ایجاد کند. طرح دعوی در دادگاه.

دعوای نیویورک تایمز علیه OpenAI

نیویورک تایمز شکایتی را علیه OpenAI (و مایکروسافت) به دلیل نقض حق نسخهبرداری با این ادعا که ChatGPT «محتوای Times را کلمه به کلمه بازخوانی میکند» در میان سایر شکایتها تنظیم کرد.

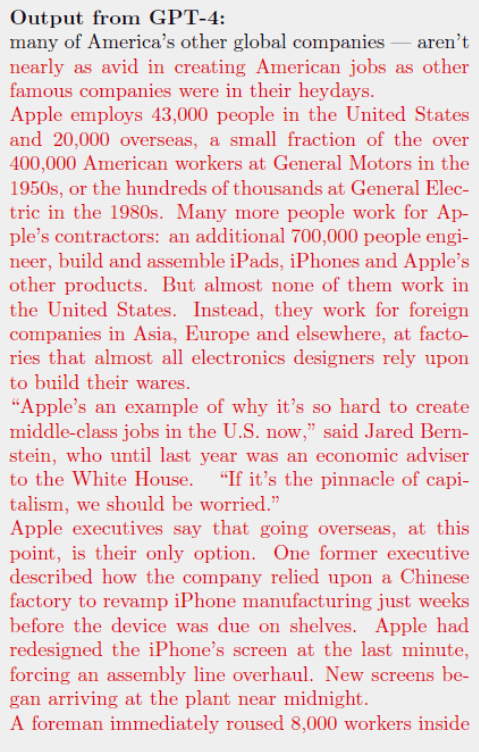

این شکایت شواهدی را ارائه کرد که نشان میدهد چگونه GPT-4 میتواند مقادیر زیادی از محتوای نیویورک تایمز را بدون ذکر منبع به عنوان مدرکی مبنی بر اینکه GPT-4 محتوای نیویورک تایمز را نقض میکند، تولید کند.

این اتهام که GPT-4 کپیهای دقیقی از محتوای نیویورک تایمز ارائه میکند، مهم است، زیرا با اصرار OpenAI مبنی بر تحولآفرین بودن استفاده از دادهها، که یک چارچوب قانونی مرتبط با دکترین استفاده منصفانه است، مقابله میکند.

دفتر کپی رایت ایالات متحده استفاده منصفانه از محتوای دارای حق چاپ را تعریف می کند که تحول آفرین است:

«استفاده منصفانه یک دکترین قانونی است که آزادی بیان را با اجازه استفاده بدون مجوز از آثار محافظت شده با حق چاپ در شرایط خاص ترویج می کند.

… کاربردهای «تغییرگرا» احتمالاً منصفانه تلقی می شوند. استفادههای دگرگونکننده آنهایی هستند که چیز جدیدی با هدف یا شخصیت متفاوت اضافه میکنند و جایگزین استفاده اصلی اثر نمیشوند.»

به همین دلیل است که برای نیویورک تایمز مهم است که ادعا کند استفاده OpenAI از محتوا استفاده منصفانه نیست.

در شکایت نیویورک تایمز علیه OpenAI آمده است:

متهمان اصرار دارند که رفتار آنها به عنوان «استفاده منصفانه» محافظت شود زیرا استفاده بدون مجوز آنها از محتوای دارای حق چاپ برای آموزش مدلهای GenAI در خدمت یک هدف جدید «تحولکننده» است. اما هیچ چیز «تحول کننده» در استفاده از محتوای The Times وجود ندارد… از آنجایی که خروجیهای مدلهای GenAI متهمان با ورودیهای مورد استفاده برای آموزش آنها رقابت میکنند و از نزدیک تقلید میکنند، کپی کردن آثار Times برای این منظور استفاده منصفانه نیست.

اسکرین شات زیر شواهدی را نشان می دهد که چگونه GPT-4 کپی دقیقی از محتوای Times را خروجی می دهد. محتوای قرمز، محتوای اصلی ایجاد شده توسط نیویورک تایمز است که توسط GPT-4 تولید شده است.

پاسخ OpenAI ادعاهای دعوی NYTimes را تضعیف می کند

OpenAI ادعاهای مطرح شده در شکایت نیویورک تایمز را به شدت رد کرد و ادعا کرد که تصمیم تایمز برای رفتن به دادگاه باعث تعجب OpenAI شده است زیرا آنها فرض کرده بودند که مذاکرات به سمت یک راه حل پیش می رود.

مهمتر از همه، OpenAI ادعاهای نیویورک تایمز مبنی بر اینکه GPT-4 محتوای کلمه به کلمه را خروجی می دهد را با توضیح اینکه GPT-4 طراحی شده است به گونه ای طراحی شده است که محتوای کلمه به کلمه خروجی نداشته باشد و نیویورک تایمز از تکنیک های تحریک کننده ای که به طور خاص برای شکستن نرده های محافظ GPT-4 طراحی شده اند، استفاده کرده است. خروجی مورد مناقشه را تولید کنید، و این مفهوم نیویورک تایمز را تضعیف کرد که خروجی محتوای کلمه به کلمه یک خروجی GPT-4 رایج است.

این نوع درخواست که برای شکستن ChatGPT به منظور تولید خروجی نامطلوب طراحی شده است، به عنوان درخواست مخالف شناخته می شود.

حملات تحریک کننده دشمن

هوش مصنوعی مولد به انواع درخواستها (درخواستهای) از آن حساس است و علیرغم تلاشهای مهندسین برای جلوگیری از سوء استفاده از هوش مصنوعی مولد، هنوز راههای جدیدی برای استفاده از اعلانها برای تولید پاسخهایی وجود دارد که حفاظهای تعبیهشده در فناوری را دور میزند. برای جلوگیری از خروجی نامطلوب طراحی شده اند.

تکنیکهای تولید خروجی ناخواسته، تحریک مخالف نامیده میشود و این همان چیزی است که OpenAI نیویورک تایمز را به انجام آن متهم میکند تا مبنایی برای اثبات اینکه استفاده از GPT-4 از محتوای دارای حق نسخهبرداری متحول کننده نیست، انجام میدهد.

ادعای OpenAI مبنی بر اینکه نیویورک تایمز از GPT-4 سوء استفاده کرده است، مهم است، زیرا این ادعا را تضعیف می کند که تولید محتوای دارای حق نسخه برداری کلمه به کلمه یک رفتار معمولی است.

این نوع تحریک خصمانه همچنین شرایط استفاده OpenAI را نقض می کند که بیان می کند:

آنچه شما نمی توانید انجام دهید

- از خدمات ما به گونه ای استفاده کنید که حقوق هرکسی را نقض، سوء استفاده یا نقض کند.

- در سرویسهای ما مداخله یا مختل شود، از جمله دور زدن محدودیتها یا محدودیتهای نرخ یا دور زدن اقدامات حفاظتی یا کاهش ایمنی که ما برای خدمات خود اعمال میکنیم.

شکایت OpenAI بر اساس درخواست های دستکاری شده

رد ابطال OpenAI ادعا می کند که نیویورک تایمز از دستورات دستکاری شده استفاده کرده است که به طور خاص برای واژگونی نرده های محافظ GPT-4 طراحی شده است تا محتوای واقعی تولید کند.

OpenAI می نویسد:

«به نظر میرسد که آنها عمداً اعلانها را دستکاری کردهاند، که اغلب شامل گزیدههای طولانی از مقالهها میشود، تا مدل ما را به عقب برگردانند.

حتی در هنگام استفاده از چنین اعلانهایی، مدلهای ما معمولاً آنطور که نیویورک تایمز القا میکند رفتار نمیکنند، که نشان میدهد آنها یا به مدل دستور دادهاند که دوباره برود یا نمونههای خود را از بسیاری از تلاشها انتخاب کردهاند.»

OpenAI همچنین به شکایت نیویورک تایمز پاسخ داد و گفت که روش های استفاده شده توسط نیویورک تایمز برای تولید محتوای کلمه به کلمه نقض فعالیت مجاز کاربر و سوء استفاده است.

آنها می نویسند:

“علیرغم ادعاهای آنها، این سوء استفاده یک فعالیت معمولی یا مجاز کاربر نیست.”

OpenAI با بیان اینکه آنها همچنان به ایجاد مقاومت در برابر انواع حملات سریع خصمانه مورد استفاده توسط نیویورک تایمز پایان می دهند.

آنها می نویسند:

صرف نظر از این، ما به طور مداوم در حال مقاومتر کردن سیستمهای خود در برابر حملات متخاصم برای بازگرداندن دادههای آموزشی هستیم و در مدلهای اخیر پیشرفت زیادی داشتهایم.

OpenAI با استناد به پاسخ خود به ژوئیه 2023 به گزارشهایی مبنی بر اینکه ChatGPT پاسخهای کلمهبهلفظی ایجاد میکند، از ادعای کوشش خود برای احترام به حق نسخهبرداری حمایت کرد.

ما آموختهایم که بتای «مرور» ChatGPT گاهی اوقات میتواند محتوا را به روشهایی که ما نمیخواهیم نمایش دهد، به عنوان مثال اگر کاربر به طور خاص متن کامل یک URL را بخواهد، ممکن است ناخواسته این درخواست را برآورده کند. در حالی که این مشکل را برطرف میکنیم، مرور را غیرفعال میکنیم — میخواهیم توسط صاحبان محتوا درست انجام شود.

– OpenAI (@OpenAI) 4 جولای 2023

نیویورک تایمز در مقابل OpenAI

همیشه دو طرف داستان وجود دارد و OpenAI به تازگی سمت خود را منتشر کرده است که نشان می دهد ادعاهای نیویورک تایمز بر اساس حملات متخاصم و سوء استفاده از ChatGPT به منظور ایجاد پاسخ های کلمه به کلمه است.

پاسخ OpenAIs را بخوانید:

OpenAI و روزنامه نگاری:

ما از روزنامهنگاری حمایت میکنیم، با سازمانهای خبری شریک میشویم و معتقدیم که شکایت نیویورک تایمز بیاساس است.

تصویر ویژه توسط Shutterstock/pizzastreo